AIエージェント経由の情報漏洩リスクとその対策

生成AI/AIエージェントの業務利用が拡大する一方で、情報漏洩の中心が「ファイル転送」だけでは語れなくなっています。

特に、ブラウザ経由での生成AI利用が増えることで、従来のファイル送信監視(従来型DLP)が得意とする“ファイル”ではなく、

コピー&ペースト(クリップボード)や画面情報といった“ファイルレス”の経路が増えています。

本記事では、AI活用の利便性を損なわず、端末側での操作制御や重要データの隔離といった「出口対策」を講じることで、安全性を確保する手法を解説します。

目次

1. 生成AI/AIエージェント利用で起きる「漏洩リスク」

1-1. NSW州政府でのChatGPTへのデータアップロード

AIツールへの不用意なデータ投入が、大規模インシデントにつながった例として、NSW州政府(NSW Reconstruction Authority)が公表した事案 があります。

公表によれば、Northern Rivers Resilient Homes Programに関するデータが2025年3月12日〜15日にかけて元一時職員によりChatGPTへアップロードされ、2031人の個人情報が影響を受けたということです。

1-2. 統計が示す死角

LayerXのレポート では、生成AI利用において77%がプロンプトへコピー&ペーストしていること、さらにその多くが未管理(企業管理外)アカウント起点であること、また生成AIへのファイルアップロードの一定割合に機微情報(センシティブ情報)が含まれることが示されています。

これは、従来の“ファイル転送監視中心”の対策だけでは捉えにくい領域(クリップボード、ブラウザ内の入力、個人アカウント利用)が増えていることを意味します。

ここから見える課題は、生成AIそのものというよりも、

- どのデータが投入されたか把握できない

- 誰がどのアカウントで投入したか統制できない

- コピペ/スクショ/アップロード等の“ファイルレス経路”が残る

2.AI活用を止めるのは難しい

危険だからと言って生成AI活用を一律に止めるのは、今の時代現実的ではありません。

そこで重要になるのは、重要データが極力外部サービスへ流出しない扱い方を先に設計することです。たとえば、特に機密性の高い業務データは保護された領域に集約して一元管理し、その領域のデータは外部の生成AIサービスには投入しない(投入禁止)ことを前提とします。

また、生成AIは会社管理アカウントでも個人アカウントでも利用できてしまう以上、アカウント統制だけで漏えいリスクを抑えきるのは難しい場面があります。

そこで、アカウントの種類に依存せず、端末上で発生するコピー&ペースト(クリップボード)や画面キャプチャ、印刷/外部デバイスへの書き出しといった持ち出し操作を制御し、重要データを保護領域に留める、というアプローチが有効です。

(※外部カメラでの撮影や手入力による転記など、端末側の制御だけでは抑止しづらい経路は運用で補完します)

3.データを守る“保護領域”という考え方

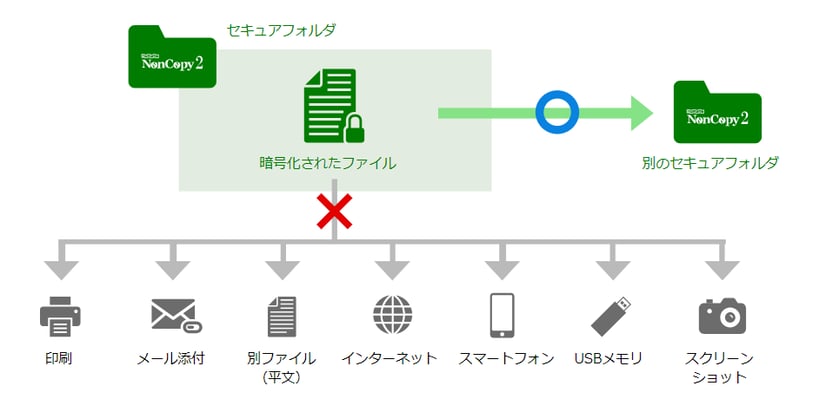

こうした方針を支える手段の一つとして、保護フォルダ(セキュアフォルダ)を中心にデータの扱いを端末側で制御するタイプの対策があります。

弊社のNonCopy 2は、指定フォルダ内のファイルを自動暗号化し、フォルダ外への持ち出しに加えて、コピー&ペースト(クリップボード)や画面キャプチャ、印刷/外部デバイスへの書き出しなどの操作を制御することで、重要データを保護領域に留める運用を支援します。

NonCopy 2の詳細については下記をご参照ください。無料の評価版もご用意しております。

4.まとめ

保護領域ベースの対策(NonCopy 2を含む)は選択肢の一つにはなりますが、これだけで全てのリスクが解消するわけではありません。

技術的に制御しづらい経路や業務上の例外も存在するため、許可された利用ルートの整備、利用ルールの策定、教育、監査、例外管理といった運用で補完し、状況に応じて他の手段も併用することが重要です。

サイエンスパークではNonCopy2以外にも、独自のドライバウェア技術を活用したサイバーセキュリティサービスをご用意しております。

詳しくはこちらをご覧ください。

関連リンク

弊社、サイエンスパーク株式会社は1994年の創業より、ソフトウェア・ハードウェアのセキュリティ対策をおよそ30年に渡り続けてまいりました。

各種製造・開発におけるセキュリティリスクの診断から対策導入・運用までのお手伝いが可能ですので、ご相談だけでもお気軽にお問い合わせくださいませ。